Lösungen für kleine Datensätze

Motivation

In vielen industriellen Anwendungen ist Datenverfügbarkeit die zentrale Einstiegshürde: zu wenig, teure und schwer zu beschaffende Daten.

Historische Daten sind häufig nur begrenzt verfügbar, unvollständig oder gar nicht vorhanden. Eine systematische Datenerhebung ist kostenintensiv – sie erfordert spezialisierte Hardware, Zeit und personelle Ressourcen. Auch das Labeling (Erstellung von Ground Truth) bindet Kapazitäten, die im operativen Geschäft oft fehlen. Zusätzlich sind relevante Ereignisse wie Oberflächenfehler, Risse oder fehlende Komponenten typischerweise selten.

Das führt zu stark unausgeglichenen Datensätzen, sogenannter Class Imbalance.

Die Konsequenz: Modelle lernen dominante Klassen zu bevorzugen und erreichen scheinbar gute Metriken, während sie die eigentlich kritischen Fälle nicht zuverlässig erkennen.

Ein Modell, das „immer OK“ vorhersagt, kann hohe Accuracy erreichen – und ist dennoch unbrauchbar.

Die Herausforderung hier lautet also: Wie lassen sich robuste Modelle trainieren, wenn Datenmenge und -qualität stark begrenzt sind? Ein naheliegender Ansatz ist Data Augmentation oder die Erzeugung von synthetischen Daten mit Simulationen. Im Folgenden möchte ich auf diese und weitere Techniken im Umgang mit kleinen Datensätzen für Supervised Learning eingehen.

Data Augmentation

Mit Data Augmentation können Trainingsdaten künstlich erweitert werden, der Datensatz wird sozusagen aufgeblasen, um ein längeres und dadurch tieferes Training zu ermöglichen. In der Praxis geschieht das oft durch Transformationen bestehender Daten, z. B.:

- Rotation

- Translation

- Hinzufügen von Rauschen

- Skalierung

- Helligkeit und Kontrast

Ziel ist es, die effektive Datenmenge zu erhöhen und das Modell robuster gegenüber Variationen zu machen. Dabei basiert das Konzept Data Augmentation auf der Annahme, dass das Label unter der Tranformation erhalten bleibt, also konsistent mit dem Input zusammen transformiert wird.

In der Praxis bedeutet das, dass bei Klassifikation das Label, also die Klassenzuordnung identisch bleibt und bei strukturierten Labels (z. B. Bounding Boxes, Segmentierungsmasken), dass die selben Transformationen auch auf das Label angewendet werden müssen.

Beispiele:

- Input Bild wird rotiert → Bounding Box wird mitrotiert

- Input Bild wird gespiegelt → Segmentierungsmaske wird gespiegelt

Nur dann decken sich die Darstellung eines Objekts im Inputbild und das Label im Ground Truth Bild noch miteinander. Ansonsten wird das Loss (der Fehler zwischen Prediction und Ground Truth) verzerrt und das Training führt zu keinem sinnvollen Ergebnis

Durch Data Augmentation kann das Modell eine bessere Generalisierung lernen und die Gefahr in ein Overfitting Problem zu laufen wird reduziert. Overfitting bezeichnet ein Auswendig lernen des Modells anhand der Trainingsdaten. Das Modell performt dann sehr gut auf den bekannten Trainingsdaten, versagt aber bei unbekannt Testdaten oder in der tatsächlichen Anwendung.

Synthetische Daten

Synthetische Daten gehen einen Schritt weiter als Data Augmentation: Statt bestehende Daten zu transformieren, werden neue Trainingsdaten vollständig künstlich erzeugt. Dabei kann man einen bestehenden kleinen Datensatz mit weiteren Daten erweitern oder einen kompletten synthetischen Datensatz für Training und Testing erzeugen. Typische Ansätze für die Generierung von synthetischen Daten sind Simulationen (z. B. physikbasierte Renderings), Game Engines und 3D-Umgebungen oder auch generative Modelle. In den großen LLMs wie ChatGPT, Gemini oder Claude werden ebenfalls solche generativen Modelle zur Bilderzeugung verwendet.

Das Ziel ist dabei gezielt Daten zu erzeugen, die im realen Datensatz selten oder schwer erfassbar sind, z. B. seltene Defekte oder spezielle Beleuchtungen in einzelnen Fertigungslinien.

Ein zentraler Vorteil ist die volle Kontrolle über den Datensatz. So kann die Datenmenge beliebig skaliert werden, je nach Anwendungsfall und Modellgröße. Generell gilt je größer ein Modell ist (also je mehr Gewichte es hat), desto größer sollte der Datensatz sein, aber desto länger dauert das Training dann auch. Ein weiterer Vorteil an Simulationsdaten ist, dass die Ground Truth Label automatisch verfügbar sind und man sich die zeitaufwendige Annotation erspart. Der größte Nachteil synthetischer Daten ist allerding die sogenannte Reality Gap:

Die Verteilung synthetischer Daten unterscheidet sich von realen Daten.

Typische Ursachen dafür sind die vereinfachte Physik in Simulationen, unrealistische Texturen oder Materialien, fehlendes Sensorrauschen oder optische Artefakte. Einige dieser Randbedingungen wie das Sensorrauschen kann man in Simulationen mit einfließen lassen, jedoch ist es sehr immer noch schwierig die Realität dadurch korrekt abzubilden und alle Einzelfälle mit einzubeziehen. Synthetische Daten können also Datenengpässe adressieren, lösen jedoch nicht automatisch das Problem der Generalisierung.

Transfer Learning

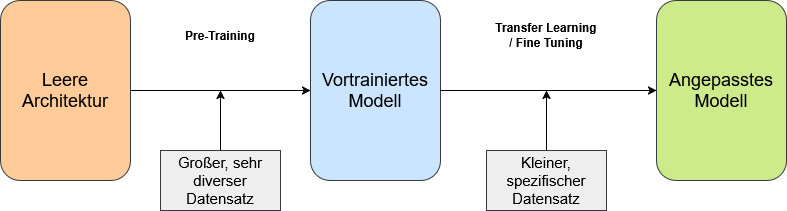

Transfer Learning verfolgt einen anderen Ansatz als Data Augmentation oder synthetische Daten. Statt neue Daten zu erzeugen, wird bereits gelerntes Wissen aus bestehenden Modellen wiederverwendet. Dabei wird ein Modell, das auf großen Datensätzen (z. B. ImageNet) trainiert wurde (sogenanntes Pre-Training), auf eine neue, meist kleinere Zielaufgabe angepasst. Diese oben-drauf trainieren nennt man Fine Tuning oder oder Transfer Learning, da ja neues Wissen in das Modell transferiert wird, aber altes Grundlagenwissen trotzdem erhalten bleibt. Das Ziel ist es, die bereits gelernten generischen Features, wie Kanten, Texturen oder grundlegende Formen zu nutzen und nur die aufgabenspezifischen Teile des Modells neu zu traineren.

Dabei kann ein Modell auch auf einer Deketionsausgabe vortrainiert und dann hinterher für eine Segmentierungsaufgabe nachtrainiert werden. Dazu ersetzt man die letzten Layer in der Architektur und verändert somit das Ausgabeformat von BoundingBoxen und Klassen hin zu Masken.

Eine weitere häufig genutzte Technik im Transfer Learning ist das Einfrieren. Dabei werden die Gewichte von vordefinierten Layern (z.B. den ersten Layern, welche für die Feature Extraktion zuständig sind) festgesetzt und während des Transfer Learning nicht mehr angepasst. Es werden also nur die restlichen Layer weiter hinten angepasst. Dadurch verkürzt sich die Trainingszeit, da ja auf bereits vorhandene Gewichte zurückgegriffen werden kann.

Grenzen und Limitationen von Tranfer Learning

Leider ist auch Transfer Learning ist kein Selbstläufer. Häufige Probleme sind:

- Domänenunterschiede: Trainingsdaten des Foundation Modells unterscheiden sich stark von der Zielaufgabe

- zu aggressives Fine-Tuning: vortrainierte Features werden „überschrieben“

- zu wenig Anpassung: Modell bleibt zu nah an der ursprünglichen Aufgabe

Das Modell kann dann das vorhandene Wissen nicht mit den neuen Trainingsdaten verknüpfen und dementsprechend schlecht schneidet es in Tests ab. Während des Trainings kann man das aber gezielt überprüfen, z.B. mit einem zusätzlich Validierungsdatensatz, welcher neben den neue auch alte Daten enthält.

Fazit

Kleine Datensätze sind kein Randproblem, sondern der Regelfall in industriellen Machine-Learning-Anwendungen. Leider gibt es keine Patentlösung für dieses Problem, sondern nur eine Kombination aus Methoden, deren Wirksamkeit stark vom konkreten Anwendungsfall abhängt.

Data Augmentation ist eine sinnvolle Möglichkeit, solange die gewählten Transformationen reale Invarianten widerspiegeln. Andernfalls führt sie zu systematischen Verzerrungen und verschlechtert die Modellleistung. Synthetische Daten erweitern den Lösungsraum deutlich, stoßen jedoch an die fundamentale Grenze des Reality Gaps. Ihre Qualität bemisst sich nicht an der Menge, sondern an der Übereinstimmung mit der realen Datenverteilung. Transfer Learning ist in vielen Szenarien der praktikabelste Ansatz, da es ermöglicht, vorhandenes Wissen aus großen Datensätzen zu nutzen und mit begrenzten Daten robuste Modelle weiter zu trainieren. Allerdings erfordert es ein kontrolliertes Fine-Tuning und ein klares Verständnis der Domänenunterschiede, um die oben benannten Fallstricke zu vermeiden.

In der Praxis ist eine gezielte Kombination dieser Ansätze zu empfehlen.